Muitos gigantes da tecnologia agora têm que apostar arriscado na IA devido ao coronavírus

A discussão de hoje será sobre os trabalhadores do Facebook e do Google – os moderadores de conteúdo que estão trabalhando na pandemia todos os dias. É uma história sobre as difíceis trocas e as ações tomadas nos últimos dias que terão um efeito significativo sobre os negócios no futuro.

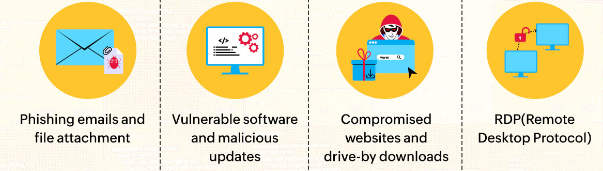

Quando chegamos à história, a moderação de conteúdo nas redes sociais nada mais era do que um problema de negócios que deixava a nudez e os nazistas e a comunidade colapsarem. Mais tarde, tornou-se um problema legal e regulatório. As empresas tinham a obrigação legal de remover propaganda terrorista, imageador de abuso infantil e outras formas de conteúdo. Após o crescimento de serviços como Google e Facebook, com base em bilhões de usuários, a moderação do conteúdo se torna um problema de grande escala. Surge a pergunta óbvia: como se pode revisar os milhões de postagens por dia que são denunciadas pela violação.

A única solução, que eu acho, é terceirizar as empresas de consultoria de emprego. Em 2016, quando o déficit de moderadores de conteúdo foi revelado, as empresas de tecnologia contrataram dezenas de milhares de moderadores em todo o mundo. Isso criou um problema de privacidade – quando os moderadores trabalham em casa, eles podem aplicar restrições, controlar e dispositivos e acessar os dados armazenados. Se eles funcionarem para terceiros, existe o risco de vazamento de dados.

Esse medo de vazamento de dados foi forte naquele período. Para o Facebook em particular, a reação das eleições pós-2016 surgiu em parte devido às preocupações com a privacidade – se o mundo soubesse que os dados são recolhidos das contas dos usuários, a confiança na empresa cairia vertiginosamente. Essa é a razão pela qual os sites de moderação de conteúdo terceirizados para o Facebook e o YouTube foram projetados como salas seguras. Os funcionários trabalham nos andares de produção que recebem e saem de crachá. Eles têm restrição de trazer dispositivos pessoais para que não tirem fotos clandestinas ou tentem contrabandear os dados. A cena é que, se alguém trouxer telefones para a área de produção, ele / ela é demitido por isso. Muitos dos trabalhadores reclamam dessas restrições, mas as empresas não desejam relaxar devido ao medo de perda de dados de alto perfil.

Avançando hoje, quando a pandemia está se espalhando pelo mundo na velocidade assustadora, ainda precisamos trabalhar como moderadores, se não – o uso será claramente crescente. Se você continuar trabalhando no chão, é mais provável que contribua para a propagação da doença. O problema é que, se você deixá-los trabalhar em casa, você convida um desastre de privacidade. Isso cria um dilema.

O que você faz se estiver no lugar do Facebook? Até segunda-feira, a resposta parecia muito com os negócios, como de costume. Sam Biddle contou essa história no Intercept na semana passada:

“As discussões do fórum interno de funcionários do Facebook, analisado pelo The Intercept, revelam um estado de confusão, medo e ressentimento, com muitos trabalhadores contratados por hora precariamente empregados, declarando que, ao contrário das declarações do Facebook, eles são impedidos por seus empregadores reais de trabalharem no trabalho. casa, apesar da viabilidade técnica e dos benefícios claros para a saúde pública.

As discussões se concentram nos contratados do Facebook empregados pela Accenture e WiPro em instalações em Austin, Texas, e Mountain View, Califórnia, incluindo pelo menos dois escritórios no Facebook. (Em Mountain View, um estado local de emergência já foi declarado por causa do coronavírus.) O Intercept viu posts de pelo menos seis contratados reclamando por não poderem trabalhar em casa e se comunicando com mais dois contratados diretamente sobre o assunto. Um funcionário da Accenture disse ao The Intercept que toda a equipe de mais de 20 contratados havia sido informada de que não era permitido trabalhar em casa para evitar infecções. ”

De acordo com as notas de Biddle, o Facebook já estava incentivando os funcionários a trabalhar em casa. Começou a informar aos moderadores do contrato que eles não deveriam entrar no escritório. O Facebook pagará em caso de interrupção. Aqui está o anúncio:

“Tanto para os funcionários em tempo integral quanto para a força de trabalho contratada, há algum trabalho que não pode ser feito em casa devido a razões de segurança, privacidade e legais. Tomamos precauções para proteger nossos funcionários, reduzindo o número de pessoas em qualquer escritório, implementando o trabalho recomendado em casa globalmente, espalhando fisicamente as pessoas em qualquer escritório e fazendo uma limpeza adicional. Dadas as preocupações de saúde pública em rápida evolução, estamos tomando medidas adicionais para proteger nossas equipes e trabalharemos com nossos parceiros ao longo desta semana para enviar todos os contratados que realizam a revisão de conteúdo para casa, até novo aviso. Garantiremos que todos os trabalhadores sejam pagos durante esse período. “

Anúncio semelhante foi seguido pelo Google no domingo. Isso foi seguido por um anúncio conjunto do Facebook, Google, Linkedin, Microsoft, Reddit, Twitter e YouTube. Então, agora os moderadores enviaram para casa. Como as coisas são moderadas? O Facebook permitiu que alguns moderadores que estão trabalhando no conteúdo menos sensível trabalhem em casa. Um trabalho mais sensível está sendo transferido para funcionários em período integral. Porém, as empresas agora começam a aprender mais sobre o sistema de aprendizado de máquina, em um esforço para automatizar a moderação de conteúdo.

Para o objetivo de longo prazo, toda rede social precisa colocar a inteligência artificial no comando. No entanto, como o Google falou sobre isso nessa visão, o dia em que isso seria possível ainda estava muito longe. No entanto, na segunda-feira, a empresa mudou de tom. Aqui está o que os Jake kastrenakes no The Verge disseram:

“O YouTube dependerá mais da IA para moderar vídeos durante a pandemia de coronavírus, já que muitos de seus revisores humanos estão sendo enviados para casa para limitar a propagação do vírus. Isso significa que os vídeos podem ser retirados do site apenas porque são sinalizados pela AI como potencialmente violadores de uma política, enquanto os vídeos normalmente podem ser encaminhados para um revisor humano para confirmar que devem ser retirados. […]

Devido à maior dependência da IA, o YouTube basicamente diz que devemos esperar que alguns erros sejam cometidos. Mais vídeos podem acabar sendo removidos, “incluindo alguns que não violam as políticas”, escreve a empresa em uma postagem no blog. Outro conteúdo não será promovido ou será exibido na pesquisa e nas recomendações até que seja revisado por humanos.

O YouTube diz que em grande parte não emitirá greves – o que pode levar a uma proibição – de conteúdo retirado pela IA (com exceção dos vídeos que possui uma “alta confiança”, são contrários às suas políticas). Como sempre, os criadores ainda podem apelar de um vídeo retirado, mas o YouTube alerta que esse processo também será adiado devido à redução da moderação humana. ”

Na segunda-feira à noite, o Facebook e o Twitter seguiram o exemplo. Aqui está o Paresh Dave na Reuters:

“O Facebook também disse que a decisão de confiar mais em ferramentas automatizadas, que aprendem a identificar material ofensivo analisando pistas digitais para aspectos comuns a quedas anteriores, tem limitações.

“Podemos ver alguns tempos de resposta mais longos e cometer mais erros como resultado”, afirmou.

O Twitter disse que também intensificaria o uso de automação semelhante, mas não proibiria os usuários com base apenas na imposição automatizada, devido a preocupações de precisão. ”

O resultado de um dia não foi ótimo, aqui o Josh Constine no TechCrunch:

“O Facebook parece ter um bug no filtro de spam do Feed de notícias, fazendo com que os URLs de sites legítimos, como Medium, BuzzFeed e USA Today, sejam impedidos de serem compartilhados como postagens ou comentários. O problema está bloqueando compartilhamentos de algum conteúdo relacionado ao coronavírus, enquanto alguns links não relacionados são permitidos, embora não esteja claro o que exatamente é ou não está desativando o filtro. O Facebook tem tentado combater a desinformação relacionada ao surto, mas pode ter ficado zeloso demais ou ter experimentado um erro técnico. ”

O Facebook diz que isso não ocorre devido a alterações na moderação do conteúdo. Enquanto isso, um dos moderadores me disse: “Estávamos trabalhando com pessoas expostas, definitivamente”. Eu acho que eles se mudaram tarde demais, e as ações inicialmente tomadas foram claramente insuficientes. ”