De nombreux géants de la technologie doivent désormais parier sur l’IA en raison du coronavirus

Notre discussion d’aujourd’hui portera sur les employés de Facebook et de Google – les modérateurs de contenu qui travaillent sur la pandémie chaque jour. C’est une histoire sur les compromis difficiles et les mesures prises au cours des derniers jours qui vont avoir un effet significatif sur les entreprises à l’avenir.

Lorsque nous arrivons à son histoire, la modération du contenu sur les réseaux sociaux n’était rien de plus qu’un problème commercial laissé dans la nudité et les nazis et la communauté s’effondre. Plus tard, c’est devenu un problème juridique et réglementaire. Les sociétés avaient l’obligation légale de supprimer la propagande terroriste, l’imageur de maltraitance des enfants et d’autres formes de contenu. Après la croissance des services comme Google et Facebook, la base d’utilisateurs en milliards, la modération du contenu devient un problème à grande échelle. La question évidente se pose de savoir comment examiner les millions de messages par jour qui sont signalés pour la violation.

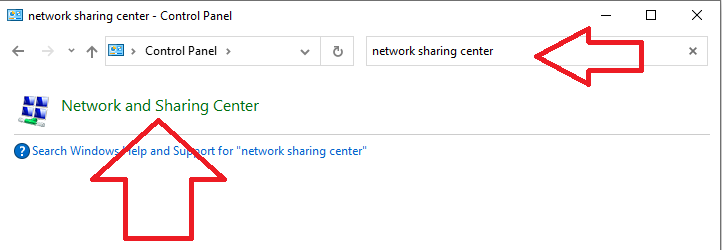

La seule solution, je pense, c’est d’externaliser les sociétés de conseil en emploi. En 2016, lorsque le déficit de modérateurs de contenu a été révélé, les entreprises technologiques ont embauché des dizaines de milliers de modérateurs dans le monde. Cela a créé un problème de confidentialité – lorsque les modérateurs travaillent en interne, ils peuvent appliquer des restrictions, contrôler et contrôler l’appareil et accéder aux données stockées. S’ils travaillent pour un tiers, il existe un risque de fuite de données.

Cette crainte des fuites de données était forte à l’époque. Pour Facebook en particulier, le retour de bâton des élections de 2016 était en partie dû aux problèmes de confidentialité – si le monde apprenait que les données sont glanées dans les comptes des utilisateurs, la confiance dans l’entreprise chuterait précipitamment. C’est la raison pour laquelle les sites de modération de contenu externalisés pour Facebook et YouTube ont été conçus comme des salles sécurisées. Les employés travaillent sur des planchers de production qui sont insérés dans et hors de. Ils ont des restrictions à apporter des appareils personnels de peur de prendre des photos clandestines ou d’essayer de faire passer les données en contrebande. La scène est que, si quelqu’un apporte des téléphones dans la salle de production, il est renvoyé pour cela. De nombreux travailleurs se plaignent de ces restrictions, mais les entreprises ne sont pas disposées à les assouplir en raison de la crainte d’une perte de données de grande envergure.

Avance rapide jusqu’à aujourd’hui, lorsque la pandémie se propage dans le monde à une vitesse effrayante, nous devons encore travailler comme les modérateurs, sinon – l’utilisation sera clairement en augmentation. Si vous continuez à travailler sur le sol, vous contribuez très probablement à la propagation de la maladie. Le problème est que si vous les laissez travailler à domicile, vous invitez à un désastre de la vie privée. Cela crée un dilemme.

Que faites-vous si vous êtes à la place de Facebook? Jusqu’à lundi, la réponse ressemblait beaucoup au business as usual. Sam Biddle a cassé cette histoire dans Intercept la semaine dernière:

“Les discussions du forum interne des employés de Facebook examinées par The Intercept révèlent un état de confusion, de peur et de ressentiment, de nombreux contractuels horaires occupant un emploi précaire déclarant que, contrairement aux déclarations qui leur sont faites par Facebook, leurs employeurs réels ne peuvent pas travailler depuis domicile, malgré la faisabilité technique et les avantages évidents pour la santé publique de le faire.

Les discussions se concentrent sur les entrepreneurs Facebook employés par Accenture et WiPro dans les installations d’Austin, au Texas, et de Mountain View, en Californie, y compris au moins deux bureaux Facebook. (À Mountain View, un état d’urgence local a déjà été déclaré pour le coronavirus.) L’Intercept a vu des messages d’au moins six entrepreneurs se plaindre de ne pas pouvoir travailler à domicile et a communiqué directement avec deux autres entrepreneurs à ce sujet. Un employé d’Accenture a déclaré à The Intercept que toute leur équipe de plus de 20 sous-traitants avait été informée qu’ils n’étaient pas autorisés à travailler à domicile pour éviter l’infection. »

Selon les notes de Biddle, Facebook encourageait déjà les employés à travailler à domicile. Il a commencé à informer les modérateurs du contrat qu’ils ne devaient pas venir au bureau. Le Facebook paiera en cas de perturbation. Voici l’annonce:

«Tant pour nos employés à temps plein que pour nos employés contractuels, certains travaux ne peuvent pas être effectués à domicile pour des raisons de sécurité, de confidentialité et juridiques. Nous avons pris des précautions pour protéger nos travailleurs en réduisant le nombre de personnes dans un bureau donné, en mettant en œuvre le travail recommandé à domicile dans le monde entier, en répartissant physiquement les personnes dans un bureau donné et en effectuant un nettoyage supplémentaire. Compte tenu de l’évolution rapide des problèmes de santé publique, nous prenons des mesures supplémentaires pour protéger nos équipes et travaillerons avec nos partenaires au cours de cette semaine pour envoyer tous les contractuels qui effectuent la révision du contenu à la maison, jusqu’à nouvel ordre. Nous veillerons à ce que tous les travailleurs soient payés pendant cette période. “

Dimanche, une annonce similaire a été suivie par Google. Cela a ensuite été suivi d’une annonce conjointe de Facebook, Google, Linkedin, Microsoft, Reddit, Twitter et YouTube. Donc, maintenant, les modérateurs sont rentrés chez eux. Comment les choses sont-elles modérées? Facebook a permis à certains modérateurs travaillant sur des contenus moins sensibles de travailler à domicile. Le travail plus sensible est transféré aux employés à temps plein. Mais, les entreprises commencent maintenant à en apprendre davantage sur le système d’apprentissage automatique dans le but d’automatiser la modération du contenu.

Pour l’objectif à long terme, chaque réseau social doit mettre l’intelligence artificielle en charge. Cependant, comme Google l’a dit à ce sujet, le jour où une telle chose serait possible était encore assez loin. Pourtant, lundi, la compagnie a changé de ton. Voici ce que les kastrenakes Jake de The Verge ont dit:

«YouTube s’appuiera davantage sur l’IA pour modérer les vidéos pendant la pandémie de coronavirus, car bon nombre de ses examinateurs humains sont renvoyés chez eux pour limiter la propagation du virus. Cela signifie que les vidéos peuvent être retirées du site uniquement parce qu’elles sont signalées par AI comme pouvant violer une politique, tandis que les vidéos peuvent normalement être acheminées vers un critique humain pour confirmer qu’elles doivent être supprimées. […]

En raison de la dépendance accrue à l’IA, YouTube dit essentiellement que nous devons nous attendre à ce que certaines erreurs soient commises. Plus de vidéos peuvent finir par être supprimées, “y compris certaines vidéos qui ne violent pas les politiques”, écrit la société dans un article de blog. Aucun autre contenu ne sera promu ou affiché dans la recherche et les recommandations tant qu’il n’aura pas été examiné par les humains.

YouTube dit qu’il n’imposera en grande partie pas de grèves – ce qui peut conduire à une interdiction – pour le contenu qui est retiré par l’IA (à l’exception des vidéos, il a une «haute confiance» sont contre ses politiques). Comme toujours, les créateurs peuvent toujours faire appel d’une vidéo qui a été retirée, mais YouTube prévient que ce processus sera également retardé en raison de la réduction de la modération humaine. »

Lundi soir, Facebook et Twitter ont emboîté le pas. Voici le Paresh Dave à Reuters:

«Facebook a également déclaré que la décision de s’appuyer davantage sur des outils automatisés, qui apprennent à identifier le matériel offensant en analysant les indices numériques pour les aspects communs aux précédentes éliminations, a ses limites.

“Nous pouvons voir des temps de réponse plus longs et faire plus d’erreurs en conséquence”, a-t-il déclaré.

Twitter a également déclaré qu’il intensifierait l’utilisation d’une automatisation similaire, mais n’interdirait pas les utilisateurs uniquement sur la base d’une application automatisée, en raison de problèmes de précision. »

Le résultat du premier jour n’était pas génial, ici le Josh Constine dans TechCrunch:

“Facebook semble avoir un bogue dans son filtre anti-spam de flux d’actualités, empêchant les URL de sites Web légitimes, notamment Medium, BuzzFeed et USA Today, d’être partagées en tant que publications ou commentaires. Le problème est de bloquer des partages de certains contenus liés aux coronavirus, tandis que certains liens non liés sont autorisés, bien qu’il ne soit pas clair ce qui est exactement ou ne déclenche pas le filtre. Facebook a tenté de lutter contre la désinformation liée à l’épidémie, mais peut-être devenu trop zélé ou a rencontré une erreur technique. “

Facebook dit que ce n’est pas dû à une modification de la modération du contenu. Entre-temps, l’un des modérateurs m’a dit: «Nous travaillions avec des personnes exposées, certainement». Je pense qu’ils sont intervenus trop tard et les mesures prises initialement étaient clairement insuffisantes. »