Muchos gigantes tecnológicos ahora tienen que arriesgarse a apostar por la IA debido al coronavirus

Nuestra discusión de hoy se centrará en los trabajadores de Facebook y Google, los moderadores de contenido que trabajan en la pandemia todos los días. Es una historia sobre las difíciles compensaciones y las acciones tomadas en los últimos días que tendrán un efecto significativo en las empresas en el futuro.

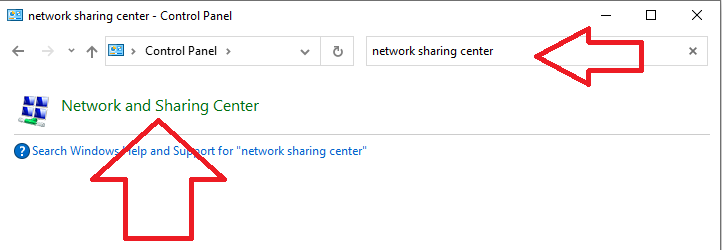

Cuando llegamos a la historia, la moderación del contenido en las redes sociales no fue más que un problema de negocios que permitió la desnudez y los nazis y la comunidad colapsaron. Más tarde, se convirtió en un problema legal y regulatorio. Las compañías tenían la obligación legal de eliminar la propaganda terrorista, el generador de imágenes de abuso infantil y otras formas de contenido. Después de que crecieron servicios como Google y Facebook, la base de usuarios en miles de millones, la moderación del contenido se convirtió en un problema a gran escala. La pregunta obvia surge cómo se pueden revisar los millones de publicaciones al día que se denuncian por la violación.

La única solución que creo es externalizar las empresas de consultoría laboral. En 2016, cuando se reveló el déficit de moderadores de contenido, las compañías tecnológicas contrataron a decenas de miles de moderadores en todo el mundo. Esto creó un problema de privacidad: cuando los moderadores trabajan en casa, pueden aplicar restricciones y controlar y controlar y acceder a los datos almacenados. Si trabajan para un tercero, existe el riesgo de fuga de datos.

Este miedo a las fugas de datos corrió fuerte esa vez. Para Facebook en particular, la reacción posterior a las elecciones de 2016 surgió en parte por las preocupaciones de privacidad: si el mundo supiera que los datos se obtienen de las cuentas de los usuarios, la confianza en la compañía se desplomaría precipitadamente. Esta es la razón por la cual los sitios de moderación de contenido subcontratados para Facebook y YouTube fueron diseñados como salas seguras. Los empleados trabajan en los pisos de producción que están dentro y fuera de la placa. Tienen restricciones para llevar cualquier dispositivo personal para que no tomen algunas fotos subrepticias o intenten contrabandear los datos. La escena es que, si alguien trae teléfonos al piso de producción, lo despiden. Muchos de los trabajadores se quejan de tales restricciones, pero las empresas no han querido relajarse debido al temor a la pérdida de datos de alto perfil.

Avancemos rápidamente hasta el día de hoy, cuando la pandemia se está extendiendo por todo el mundo a una velocidad aterradora, aún debemos trabajar como los moderadores, si no, el uso claramente aumentará. Si continúa trabajando en el piso, lo más probable es que contribuya a la propagación de la enfermedad. El problema es que si los dejas trabajar desde casa, invitas a un desastre de privacidad. Esto crea un dilema.

¿Qué haces si estás en el lugar de Facebook? Hasta el lunes, la respuesta se parecía mucho a lo de siempre. Sam Biddle reveló esta historia en Intercept la semana pasada:

“Las discusiones del foro interno de empleados de Facebook revisado por The Intercept revelan un estado de confusión, miedo y resentimiento, con muchos trabajadores por contrato con empleo precario que afirman que, en contra de las declaraciones de Facebook, sus empleadores reales les impiden trabajar hogar, a pesar de la viabilidad técnica y los claros beneficios para la salud pública de hacerlo.

Las discusiones se centran en los contratistas de Facebook empleados por Accenture y WiPro en las instalaciones de Austin, Texas y Mountain View, California, incluidas al menos dos oficinas de Facebook. (En Mountain View, ya se ha declarado un estado de emergencia local sobre el coronavirus). La Intercepción ha visto publicaciones de al menos seis contratistas quejándose de no poder trabajar desde casa y se comunicó directamente con dos contratistas más sobre el asunto. Un empleado de Accenture le dijo a The Intercept que a todo su equipo de más de 20 contratistas les habían dicho que no se les permitía trabajar desde casa para evitar infecciones ”.

Según las notas de Biddle, Facebook ya estaba alentando a los empleados a trabajar desde casa. Comenzó a informar a los moderadores del contrato que no deberían ingresar a la oficina. Facebook pagará en caso de interrupción. Aquí está el anuncio:

“Tanto para nuestros empleados a tiempo completo como para la fuerza laboral por contrato, hay algunos trabajos que no se pueden hacer desde casa debido a razones de seguridad, privacidad y legales. Hemos tomado precauciones para proteger a nuestros trabajadores reduciendo el número de personas en cualquier oficina, implementando el trabajo recomendado desde el hogar a nivel mundial, distribuyendo físicamente a las personas en cualquier oficina y haciendo una limpieza adicional. Dada la rápida evolución de las preocupaciones de salud pública, estamos tomando medidas adicionales para proteger a nuestros equipos y trabajaremos con nuestros socios en el transcurso de esta semana para enviar a todos los trabajadores contratados que realizan la revisión de contenido a casa, hasta nuevo aviso. Nos aseguraremos de que todos los trabajadores sean remunerados durante este tiempo “.

Anuncio similar fue seguido de Google el domingo. Esto fue seguido por un anuncio conjunto de Facebook, Google, Linkedin, Microsoft, Reddit, Twitter y YouTube. Entonces, ahora los moderadores han enviado a casa. ¿Cómo se moderan las cosas? Facebook permitió que algunos moderadores que están trabajando en el contenido menos sensible trabajen desde casa. El trabajo más sensible se está trasladando a los empleados a tiempo completo. Pero, las compañías ahora comienzan a aprender más sobre el sistema de aprendizaje automático en un esfuerzo por automatizar la moderación de contenido.

Para el objetivo a largo plazo, cada red social debe poner a cargo la inteligencia artificial. Sin embargo, como Google contó sobre esto en esta opinión, el día en que tal cosa sería posible todavía estaba bastante lejos. Sin embargo, el lunes, la compañía cambió su tono. Esto es lo que dijeron los kastrenakes de Jake en The Verge:

“YouTube dependerá más de la IA para moderar videos durante la pandemia de coronavirus, ya que muchos de sus revisores humanos están siendo enviados a casa para limitar la propagación del virus. Esto significa que los videos pueden ser eliminados del sitio simplemente porque están marcados por AI como potencialmente violadores de una política, mientras que los videos normalmente pueden ser enviados a un revisor humano para confirmar que deben ser eliminados. […]

Debido a la mayor dependencia de la IA, YouTube básicamente dice que tenemos que esperar que se cometan algunos errores. Es posible que se eliminen más videos, “incluidos algunos videos que pueden no violar las políticas”, escribe la compañía en una publicación de blog. Otro contenido no se promocionará ni aparecerá en las búsquedas y recomendaciones hasta que sea revisado por humanos.

YouTube dice que en gran medida no emitirá huelgas, lo que puede conducir a una prohibición, para el contenido que es eliminado por AI (con la excepción de los videos que tiene una “alta confianza” en contra de sus políticas). Como siempre, los creadores aún pueden apelar un video que fue eliminado, pero YouTube advierte que este proceso también se retrasará debido a la reducción de la moderación humana “.

El lunes por la noche, Facebook y Twitter siguieron el ejemplo. Aquí está el Paresh Dave en Reuters:

“Facebook también dijo que la decisión de confiar más en herramientas automatizadas, que aprenden a identificar material ofensivo mediante el análisis de pistas digitales para los aspectos comunes a derribos anteriores, tiene limitaciones.

“Podemos ver algunos tiempos de respuesta más largos y cometer más errores como resultado”, dijo.

Twitter dijo que también aumentaría el uso de automatización similar, pero no prohibiría a los usuarios basados únicamente en la aplicación automatizada, debido a preocupaciones de precisión ”.

El primer día no fue excelente, aquí Josh Constine en TechCrunch:

“Facebook parece tener un error en su filtro de spam de News Feed, lo que hace que las URL de sitios web legítimos como Medium, BuzzFeed y USA Today se bloqueen para que no se compartan como publicaciones o comentarios. El problema es bloquear el uso compartido de algunos contenidos relacionados con el coronavirus, mientras que se permiten algunos enlaces no relacionados, aunque no está claro qué es exactamente lo que se activa o no el filtro. Facebook ha estado tratando de luchar contra la información errónea relacionada con el brote, pero puede haberse vuelto demasiado celoso o haber experimentado un error técnico “.

Facebook dice que esto no se debe a cambios en la moderación de contenido. Mientras tanto, uno de los moderadores me dijo: “Estábamos trabajando con personas que estuvieron expuestas, definitivamente”. Creo que se han movido demasiado tarde, y las acciones tomadas inicialmente fueron claramente insuficientes “.