Viele Technologiegiganten müssen aufgrund des Coronavirus jetzt riskant auf KI setzen

In unserer heutigen Diskussion geht es um die Mitarbeiter von Facebook und Google – die Content-Moderatoren, die jeden Tag an der Pandemie arbeiten. Es ist eine Geschichte über die schwierigen Kompromisse und die in den letzten Tagen ergriffenen Maßnahmen, die sich in Zukunft erheblich auf die Unternehmen auswirken werden.

Wenn wir zur Geschichte kommen, war die Moderation von Inhalten in sozialen Netzwerken nichts anderes als ein Geschäftsproblem, das die Nacktheit hereinließ und die Nazis und die Gemeinschaft zusammenbrachen. Später wurde es ein rechtliches und regulatorisches Problem. Die Unternehmen waren gesetzlich verpflichtet, terroristische Propaganda, Kindesmissbrauchsbilder und andere Formen von Inhalten zu entfernen. Nachdem die Dienste wie Google und Facebook gewachsen sind und die Nutzer eine Milliardenbasis haben, wird die Moderation von Inhalten zu einem großen Problem. Es stellt sich die offensichtliche Frage, wie man die Millionen von Posts pro Tag überprüfen kann, die wegen des Verstoßes gemeldet werden.

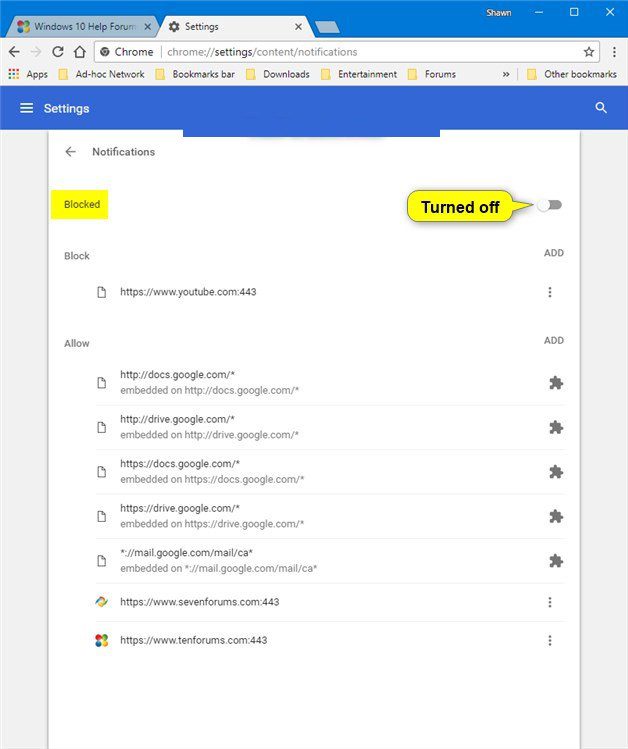

Die einzige Lösung, die ich denke, besteht darin, die Beratungsunternehmen auszulagern. Im Jahr 2016, als ein Defizit an Content-Moderatoren festgestellt wurde, stellten Technologieunternehmen Zehntausende von Moderatoren auf der ganzen Welt ein. Dies führte zu einem Datenschutzproblem. Wenn Moderatoren im eigenen Haus arbeiten, können sie Einschränkungen anwenden und die gespeicherten Daten steuern und auf Geräte übertragen. Wenn sie für Dritte arbeiten, besteht die Gefahr eines Datenverlusts.

Diese Angst vor Datenlecks war damals groß. Insbesondere für Facebook war die Gegenreaktion bei den Wahlen nach 2016 teilweise auf Datenschutzbedenken zurückzuführen. Wenn die Welt erfahren würde, dass die Daten aus den Konten der Benutzer stammen, würde das Vertrauen in das Unternehmen stark sinken. Aus diesem Grund wurden die ausgelagerten Websites zur Moderation von Inhalten für Facebook und YouTube als sichere Räume konzipiert. Die Mitarbeiter arbeiten in Produktionsstätten, in denen ein- und ausgehen. Sie dürfen nur persönliche Geräte mitbringen, damit sie keine Schleichfotos machen oder versuchen, die Daten herauszuschmuggeln. Die Szene ist, dass, wenn jemand Telefone in die Produktion bringt, er / sie dafür gefeuert wird. Viele der Beschäftigten beschweren sich über solche Einschränkungen, aber die Unternehmen waren bereit, sich nicht zu entspannen, weil sie befürchten, dass Daten verloren gehen.

Schneller Vorlauf bis heute, wenn sich die Pandemie mit erschreckender Geschwindigkeit auf der ganzen Welt ausbreitet, müssen wir immer noch wie die Moderatoren arbeiten, wenn nicht – die Nutzung wird deutlich zunehmen. Wenn Sie sie weiterhin auf dem Boden arbeiten, tragen Sie höchstwahrscheinlich zur Ausbreitung der Krankheit bei. Das Problem ist, dass Sie eine Datenschutzkatastrophe einladen, wenn Sie sie von zu Hause aus arbeiten lassen. Dies schafft ein Dilemma.

Was machst du, wenn du anstelle von Facebook bist? Bis Montag sah die Antwort wie gewohnt aus. Sam Biddle hat diese Geschichte letzte Woche im Intercept veröffentlicht:

„Diskussionen aus dem internen Mitarbeiterforum von Facebook, die von The Intercept geprüft wurden, zeigen einen Zustand der Verwirrung, Angst und Ressentiments. Viele prekär beschäftigte Stundenarbeiter geben an, dass sie entgegen den Aussagen von Facebook von ihren tatsächlichen Arbeitgebern daran gehindert werden, von dort aus zu arbeiten zu Hause, trotz der technischen Machbarkeit und der klaren Vorteile für die öffentliche Gesundheit.

Die Diskussionen konzentrieren sich auf Facebook-Auftragnehmer, die bei Accenture und WiPro in Einrichtungen in Austin, Texas, und Mountain View, Kalifornien, beschäftigt sind, einschließlich mindestens zwei Facebook-Büros. (In Mountain View wurde bereits ein lokaler Ausnahmezustand für das Coronavirus ausgerufen.) Im Intercept wurden Beiträge von mindestens sechs Auftragnehmern veröffentlicht, die sich darüber beschwerten, dass sie nicht von zu Hause aus arbeiten können, und mit zwei weiteren Auftragnehmern direkt über die Angelegenheit kommuniziert. Ein Mitarbeiter von Accenture teilte The Intercept mit, dass seinem gesamten Team von über 20 Auftragnehmern mitgeteilt worden sei, dass sie nicht von zu Hause aus arbeiten dürften, um Infektionen zu vermeiden. “

Laut den Biddle-Notizen ermutigte Facebook die Mitarbeiter bereits, von zu Hause aus zu arbeiten. Es begann die Vertragsmoderatoren zu informieren, dass sie nicht ins Büro kommen sollten. Das Facebook zahlt im Falle einer Störung. Hier ist die Ankündigung:

„Sowohl für unsere Vollzeitbeschäftigten als auch für Vertragsbedienstete gibt es einige Arbeiten, die aus Sicherheits-, Datenschutz- und rechtlichen Gründen nicht von zu Hause aus ausgeführt werden können. Wir haben Vorkehrungen getroffen, um unsere Mitarbeiter zu schützen, indem wir die Anzahl der Personen in einem bestimmten Büro verringert, die empfohlene Arbeit von zu Hause aus weltweit umgesetzt, die Mitarbeiter in einem bestimmten Büro physisch verteilt und zusätzliche Reinigungsarbeiten durchgeführt haben. Angesichts der sich rasch entwickelnden Bedenken hinsichtlich der öffentlichen Gesundheit unternehmen wir zusätzliche Schritte, um unsere Teams zu schützen, und werden im Laufe dieser Woche mit unseren Partnern zusammenarbeiten, um alle Vertragsarbeiter, die eine Inhaltsprüfung durchführen, bis auf weiteres nach Hause zu schicken. Wir werden sicherstellen, dass alle Arbeitnehmer in dieser Zeit bezahlt werden. “

Eine ähnliche Ankündigung folgte am Sonntag von Google. Es folgte eine gemeinsame Ankündigung von Facebook, Google, Linkedin, Microsoft, Reddit, Twitter und YouTube. Nun haben die Moderatoren nach Hause geschickt. Wie wird das Zeug moderiert? Facebook erlaubte einigen Moderatoren, die an weniger sensiblen Inhalten arbeiten, von zu Hause aus zu arbeiten. Sensiblere Arbeit wird auf Vollzeitbeschäftigte verlagert. Jetzt lernen die Unternehmen mehr über maschinelles Lernsystem, um die Moderation von Inhalten zu automatisieren.

Für das langfristige Ziel muss jedes soziale Netzwerk künstliche Intelligenz einsetzen. Wie Google jedoch aus dieser Sicht sagte, war der Tag, an dem so etwas möglich sein würde, noch ziemlich weit entfernt. Doch am Montag änderte das Unternehmen seine Einstellung. Folgendes sagten die Jake-Kastrenakes im The Verge:

„YouTube wird sich während der Coronavirus-Pandemie mehr auf KI verlassen, um Videos zu moderieren, da viele seiner menschlichen Rezensenten nach Hause geschickt werden, um die Verbreitung des Virus zu begrenzen. Dies bedeutet, dass Videos möglicherweise nur deshalb von der Website entfernt werden, weil sie von AI als potenziell gegen eine Richtlinie verstoßend gekennzeichnet werden, während die Videos normalerweise an einen menschlichen Prüfer weitergeleitet werden, um zu bestätigen, dass sie entfernt werden sollten. […]

Aufgrund der stärkeren Abhängigkeit von KI müssen wir laut YouTube grundsätzlich damit rechnen, dass einige Fehler gemacht werden. Weitere Videos werden möglicherweise entfernt, “einschließlich einiger Videos, die möglicherweise nicht gegen Richtlinien verstoßen”, schreibt das Unternehmen in einem Blogbeitrag. Andere Inhalte werden erst beworben oder in der Suche und in Empfehlungen angezeigt, wenn sie von Menschen überprüft wurden.

YouTube sagt, dass es größtenteils keine Streiks – was zu einem Verbot führen kann – für Inhalte gibt, die von der KI entfernt werden (mit Ausnahme von Videos, die ein “hohes Vertrauen” haben, das gegen seine Richtlinien verstößt). Wie immer können Entwickler immer noch gegen ein Video appellieren, das entfernt wurde. YouTube warnt jedoch davor, dass sich dieser Prozess aufgrund der geringeren menschlichen Mäßigung ebenfalls verzögern wird. “

Am Montagabend folgten sowohl Facebook als auch Twitter dem Beispiel. Hier ist der Paresh Dave in Reuters:

„Facebook sagte auch, dass die Entscheidung, sich mehr auf automatisierte Tools zu verlassen, die lernen, anstößiges Material zu identifizieren, indem digitale Hinweise auf Aspekte analysiert werden, die bei früheren Abschaltungen üblich waren, Einschränkungen hat.

“Wir sehen möglicherweise längere Reaktionszeiten und machen dadurch mehr Fehler”, hieß es.

Twitter sagte, es würde auch die Verwendung ähnlicher Automatisierung verstärken, aber Benutzer, die ausschließlich auf automatisierter Durchsetzung basieren, aus Genauigkeitsgründen nicht verbieten. “

Das Ergebnis des ersten Tages war nicht großartig, hier der Josh Constine in TechCrunch:

„Facebook scheint einen Fehler im Spamfilter des Newsfeeds zu haben, der dazu führt, dass URLs zu legitimen Websites wie Medium, BuzzFeed und USA Today nicht mehr als Beiträge oder Kommentare geteilt werden. Das Problem besteht darin, Freigaben für einige Coronavirus-bezogene Inhalte zu blockieren, während einige nicht verwandte Links zugelassen sind, obwohl nicht klar ist, was genau der Filter auslöst oder nicht. Facebook hat versucht, sich gegen Fehlinformationen im Zusammenhang mit dem Ausbruch zu wehren, ist jedoch möglicherweise übereifrig geworden oder hat einen technischen Fehler festgestellt. “

Facebook sagt, dies liege nicht an einer Änderung der Inhaltsmoderation. In der Zwischenzeit sagte mir einer der Moderatoren: „Wir haben definitiv mit Leuten zusammengearbeitet, die exponiert waren.“ Ich denke, sie sind zu spät umgezogen, und die ursprünglich ergriffenen Maßnahmen waren eindeutig unzureichend. “